Python分布式爬虫(三) - 爬虫基础知识

0 相关源码

1 技术选型 爬虫能作什么

1.1 scrapy VS requests + beautifulsoup

作爬虫的时候,常常都会听到 scrapy VS requests+beautifulsoup的组合 在本次分布式爬虫实现中只用scrapy而不用后者的缘由是:css

-

requests和beautifulsoup都是库,scrapy是一个框架 框架中能够应用requests等,能够集合不少第三方库html -

基于

twisted(异步IO框架) 性能是最大的优点web -

方便扩展 提供了不少内置的功能,提升开发速度ajax

-

内置

css和xpath selector对html或者xml进行分析,很是方便,beautifulsoup缺点就是慢正则表达式

实践中仍是会用到requests,可是不会用到beautifulsoup,由于它的功能能够直接使用scrapy的select完成.数据库

1.2 网页分类

常见类型的服务

-

静态网页 事先在服务器端生成好的页面,内容固定缓存

-

动态网页 从服务器端取数据返回bash

-

webservice(REST API) 也是属于动态网页的一种,只是经过ajax方式和后台交互的一种技术服务器

1.3 爬虫能作什么

-

搜索引擎-百度,google,垂直领域搜索引擎(有一个目标,知道本身到底爬什么数据)网络

-

推荐引擎-今日头条(根据浏览习惯猜想感兴趣的内容进行推送)

-

机器学习的数据样本

-

数据分析-金融数据分析,舆情分析

2 正则表达式

2.1 为什么须要

为何有css或者xpath selector还要学正则表达式,有时候根据selector得到了整个标签内的内容,可是还要进行进一步的筛选,好比里面的数字信息等

2.2 做用

能够帮咱们判断某个字符串是否符合某一个模式 提取整个字符串里面的重要的部分信息

2.3 经常使用字符的用法

^ : 以什么字符开头$ : 以什么字符结尾. : 任意字符* :出现任意次数,0次或者更屡次():还提取按模式取出来的子串。例如,".*(b.\*b).\*"表示无论先后是什么的两个b之间的子串? :下面详解+ :字符至少出现一次{1}:前面的字符出现一次{3,}: 要求前面的字符必须出现3次以上{2,5}:前面的字符至少出现2次,最少出现5次| : 或的关系\[\] : 中括号里面的内容只要知足任何一个便可,也能够是一个区间,中括号里面的^表示不等于,中括号里面的符号就是符号,不是特殊符号的含义\\s :表示空格符\\S : 恰好与小s的意思相反,只要不是空格均可以\\w : 表示\[A-Za-z0-9_\]其中的任意一个字符\\W : 与\\w的意思恰好相反\[\\u4E00-\\u9FA5\] : unicode编码,含义是汉字,意思是只要出现汉字就能够。\\d : 表示数字

复制代码

2.4 coding 演示

新建项目

复制代码

^ : 以什么字符开头 此处以J开头便可!

复制代码

$ : 以什么字符结尾 此处以4结尾便可!

复制代码

J开头,中间为任意字符,最后以4结尾

复制代码

? : 非贪婪匹配模式

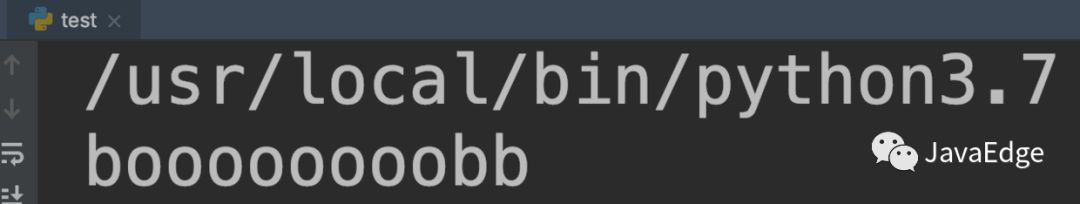

默认的状况下,匹配是贪婪模式,匹配最大长度 好比对于 "bobby123"这个待匹配的,结果就是bb,而不是bobb,因此这就是贪婪,反向匹配(或者理解成直到结束符合的最后一个结果) 非贪婪匹配就是从左边开始,只须要出现一个结果就能够了,".?(b.?b)."表示对两个b从左到右只要出现一次就可 ".?(b.b)."第二个b不要问好,那么第二个b就是贪婪模式,会持续匹配到最后一个b

-

如今源数据变动为

-

欲取得字符串

boooooooob

-

然而现实,倒是

非贪婪模式尽量少的匹配所搜索的字符串,而默认的贪婪模式则尽量多的匹配所搜索的字符串。例如,对于字符串“oooo”,“o+?”将匹配单个“o”,而“o+”将匹配全部“o”。

此处贪婪匹配最开始时反向匹配,从右向左,因此获得bb结果串!就没法提取目标串!何解?

那就须要咱们的 `?`了!变成一种非贪婪模式

复制代码

因而咱们,更改匹配规则

复制代码

结果使人失望!竟然还多了个小b!!!虽然左部分正常匹配左边的b了,可是规则的右部分依旧贪婪匹配!必须让规则右边的b不要那么贪婪!给他也加个 `?`修饰~便可!

复制代码

终于......提取成功啦!

复制代码

限定出现次数

| : 表示或关系

-

下面更改源字符串

-

规则

-

结果

-

想要提取完整的怎么作呢?

-

结果

[]

规则

复制代码

结果

复制代码

-

匹配电话号码

规则

复制代码

其中有 `^`

复制代码

\s

- \S只能匹配一个非空字符!!!

\w

汉字编码

-

源字符串

-

想提取究竟是什么大学

-

这样也是不行的,又产生了贪婪匹配问题

-

因此要加上

?取消贪婪

完美提取XX大学

d D

-

源字符串

-

想提取1997

-

这样是不够的,只能提取出7

-

这样就ok啦!

-

或者必须取消贪婪

综合实战

-

源字符串

-

可提取1,2,3,4

-

如下为完美解决规则

3 深度优先和广度优先原理

爬虫的基本原理,一个网站的url设计是分层的,树形结构,可以让咱们爬取网站的时候更加有策略。 在设计网站url时候是不会有环路的,可是在真实网站url连接的结构中,是有环路的。 好比,从首页到达某个页面,这个页面上会有返回首页的连接。若是一直进入这个死循环,那么其余页面就爬取不到内容了。因此须要用到网页的去重。 伯乐在线网站的文章爬取其中获取到的文章url是不会重复的,就不须要去重。但大多数文章都须要去重。

- 树形结构的URL设计

scrapy默认使用深度优先实现的,深度优先使用递归实现的,广度优先是采用队列来实现的

-

深度优先

-

广度优先

4 爬虫去重策略

-

将访问过的url保存到数据库中 获取url时查询一下是否爬过了.虽然数据库中有缓存,可是每次都查询效率很低.

-

将url保存到set中 只须要O(1)的代价就能够查询到url,可是内存占用会愈来愈大 假设有1亿条url,那么就须要1亿 x 2byte x 50字符/1024/1024/1024=8G

-

url通过

md5等方法后保存到set中 将url压缩到固定长度并且不重复,scrapy实际上就是应用这种方法 -

用bitmap方法 将访问过的url经过hash函数映射到某一位,对内存压缩更大,缺点是冲突比较高

-

bloomfilter方法对bitmap进行改进 多重hash函数下降冲突可能性。即减小内存,又减小冲突。

5 字符串编码

字符串编码,写文件以及网络传输过程当中,调用某些函数,常常碰到提示编码错误.

计算机只能处理数字,文本转换为数字才能处理. 计算机中8个bit做为一个字节,因此一个字节能表示最大的数字就是255

复制代码

计算机是美国人发明的 一个字节能够表示全部字符了,因此ASCII(一个字节)编码就成为美国人的标准编码

复制代码

可是ASCII处理中文明显是不够的 中文不止255个汉字,因此中国制定了 `GB2312`编码,用两个字节表示一个汉字. GB2312还把ASCII包含进去了,同理,日文,韩文等等上百个国家为了解决这个问题就都发展了一套字节的编码,标准就愈来愈多,若是出现多种语言混合显示就必定会出现乱码.

复制代码

因而 `unicode`出现了,将全部语言统一到一套编码里

复制代码

看一下ASCII和unicode编码:

字母A用ASCII编码十进制是65,二进制 0100 0001

复制代码

汉字"中" 已近超出ASCII编码的范围,用unicode编码是20013二进制是01001110 00101101

复制代码

A用unicode编码只须要前面补0二进制是 00000000 0100 0001

复制代码

乱码问题解决了,可是若是内容全是英文,unicode编码比ASCII编码须要多一倍的存储空间,传输也会变慢

复制代码

因此此时出现了可变长的编码utf-8 把英文:1字节,汉字3字节,特别生僻的变成4-6字节,若是传输大量的英文,utf8做用就很明显。Unicode编码虽然占用空间可是由于占用空间大小等额,在内存中处理会简单一些。

复制代码

关于Mac(Linux同理)下编码格式问题

复制代码

如下为 Python2 操做环境!!!

py字符串在内存中全是用Unicode进行编码的

复制代码

在Mac下实际上默认是utf8编码

复制代码

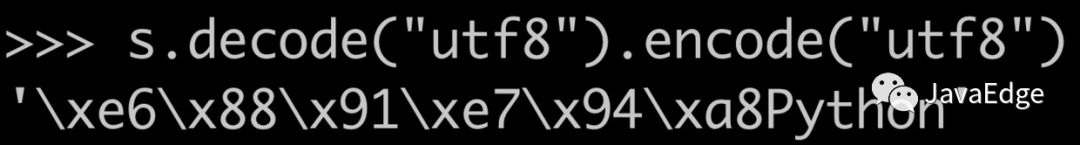

在调用encode以前,必须把前面的变量转化为Unicode编码.

复制代码

本来是utf8编码的不能直接编码成utf8,由于Python中使用encode方法,前面的变量必须都是Unicode编码的

复制代码

因此每次执行encode前必须先decode成Unicode编码

复制代码

正由于Python2存在编解码问题,因此老项目都须要一个文件头

复制代码

Python3则不存在此问题,内部所有使用Unicode编码!!!

如下为 Python3 操做环境!!!

参考

正则表达

- 1. python爬虫基础知识

- 2. Python爬虫-基础知识

- 3. 【爬虫】分布式爬虫

- 4. 爬虫 - 分布式爬虫

- 5. 爬虫基础知识

- 6. 爬虫-day01-基础知识

- 7. 爬虫的基础知识

- 8. day01 - 爬虫基础知识

- 9. 爬虫基础知识1

- 10. 爬虫究竟是什么?python爬虫基础知识

- 更多相关文章...

- • R 基础运算 - R 语言教程

- • R 语言基础 - R 语言教程

- • 常用的分布式事务解决方案

- • 再有人问你分布式事务,把这篇扔给他

-

每一个你不满意的现在,都有一个你没有努力的曾经。

- 1. eclipse设置粘贴字符串自动转义

- 2. android客户端学习-启动模拟器异常Emulator: failed to initialize HAX: Invalid argument

- 3. android.view.InflateException: class com.jpardogo.listbuddies.lib.views.ListBuddiesLayout问题

- 4. MYSQL8.0数据库恢复 MYSQL8.0ibd数据恢复 MYSQL8.0恢复数据库

- 5. 你本是一个肉体,是什么驱使你前行【1】

- 6. 2018.04.30

- 7. 2018.04.30

- 8. 你本是一个肉体,是什么驱使你前行【3】

- 9. 你本是一个肉体,是什么驱使你前行【2】

- 10. 【资讯】LocalBitcoins达到每周交易比特币的7年低点

- 1. python爬虫基础知识

- 2. Python爬虫-基础知识

- 3. 【爬虫】分布式爬虫

- 4. 爬虫 - 分布式爬虫

- 5. 爬虫基础知识

- 6. 爬虫-day01-基础知识

- 7. 爬虫的基础知识

- 8. day01 - 爬虫基础知识

- 9. 爬虫基础知识1

- 10. 爬虫究竟是什么?python爬虫基础知识